Claude выпускает надстройку Excel для Уолл-стрит — 1 000 бета-мест, 55,3% на Vals

Stay in the loop

Free daily newsletter & Telegram daily report

Executive Summary

Anthropic идет прямо против рабочих потоков Wall Street через expansion Claude для финансовых услуг, который на самом деле соответствует тому, где живут аналитики: Excel. Новая боковая панель‑плагин (бета‑версия для первых 1 000 пользователей) читает, отслеживает и редактирует листы с связанных объяснениями и отслеживаемыми изменениями, чтобы каждый правка была аудитируемой. Внутренне Sonnet 4.5 теперь обгоняет benchmark Vals Finance Agent примерно до 55,3% точности — не идеально, но достаточно, чтобы подвергать стрессу дневные модели и компы без постоянного надзора.

Игра строится на распространении плюс строгость. Семь живых коннекторов подводят 가격 LSEG и макроэкономику, рейтинги Moody’s, звонки об итогах Aiera, экспертные инсайты Third Bridge, портфолио Chronograph PE, данные Egnyte, заголовки MT Newswires, уменьшая риск копирования и вставки и сохраняя чистоту происхождения данных. Шесть готовых навыков Agent помогают основным задачам — компы, DCF‑модели, записи по результатам, пакеты due diligence, профили компаний и запуск обзора — чтобы молодшие имели рычаги, а старшие сохраняли контроль. Ранние адоптеры включают Moody’s, RBC, Carlyle и Amwins, что сигнализирует: это не просто демонстрационная цепь.

Это правильная высадка: электронные таблицы дают проверяемые ответы и чистую аудиторию аудита, делая их редкой корпоративной поверхностью, на которой AI‑агенты могут выходить за рамки, не разрушая управление.

Feature Spotlight

Особенность: Claude нацеливается на рабочие процессы Уолл-стрит.

Anthropic перемещает Claude в поток аналитиков: надстройка для Excel (1,000 бета‑пользователей), живые коннекторы (LSEG, Moody’s, Aiera и др.), и навыки агента (DCF, сопоставления, охват) сигнализируют о серьезном корпоративном продвижении в сферу финансов.

Самая крупная история по кросс‑аккаунтам сегодня: Anthropic расширяет «Claude for Financial Services» надстройкой Excel, коннекторами данных и рынков в реальном времени, а также готовыми навыками агента. Несколько публикаций, конкретный корпоративный охват; исключаются другие пункты ниже.

Jump to Особенность: Claude нацеливается на рабочие процессы Уолл-стрит. topicsTable of Contents

📊 Особенность: Claude нацеливается на рабочие процессы Уолл-стрит.

Самая крупная история по кросс‑аккаунтам сегодня: Anthropic расширяет «Claude for Financial Services» надстройкой Excel, коннекторами данных и рынков в реальном времени, а также готовыми навыками агента. Несколько публикаций, конкретный корпоративный охват; исключаются другие пункты ниже.

Anthropic запускает Claude для Excel в бета-версии с коннекторами рынка в реальном времени и готовыми навыками аналитика

Антропик расширил Claude для финансовых услуг новым надстройкой Excel в бета‑версии для Max, Enterprise и Teams, доступной для первых 1 000 пользователей и регистрирующей прозрачные, отслеживаемые правки прямо в таблице release thread, beta note, и Anthropic blog. Также добавлены соединители данных в реальном времени и шесть готовых навыков агента, ориентированных на основные процессы на Уолл‑стрит feature brief, feature recap.

- Excel co‑pilot в боковой панели: чтение, анализ, трассировка и изменение рабочих книг с пояснениями к связанным ячейкам и отслеживаемыми изменениями; бета‑версия ограничена 1 000 пользователями для обратной связи beta note, Anthropic blog.

- Живые коннекторы (доступ к данным предприятия): ценообразование/макро LSEG, рейтинги Moody’s/данные по компаниям, аудиозвонки Aiera, экспертные обзоры Third Bridge, портфели Chronograph PE, data rooms Egnyte и глобальные заголовки MT Newswires feature brief.

- Готовые навыки агента (ready‑made playbooks): сопоставимый анализ компаний, модели дисконтированных денежных потоков, комплекты due‑diligence, тизеры/профили компаний, анализы по прибылям и убыткам и отчеты об инициировании обзора feature recap.

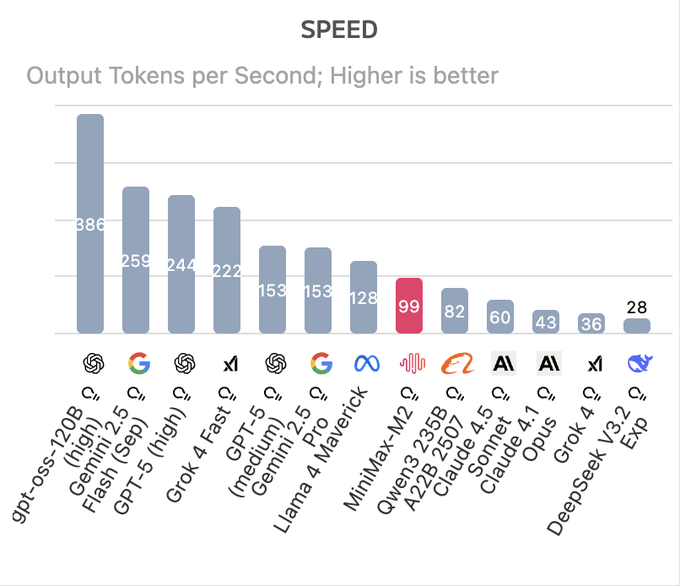

- Емкость бенча: Claude Sonnet 4.5 лидирует в бенчмарке Vals Finance Agent с точностью около ~55.3%, поддерживая вертикализацию feature brief, с видимой таблицей лидерборда benchmark table.

- Ранние adopters: Anthropic выделяет организации вроде Moody’s, RBC, Carlyle и Amwins, которые уже применяют Claude в финансовом контексте feature brief, Anthropic blog.

- Зачем это важно: электронные таблицы — структурированные, поддающиеся аудиту поверхности с достоверными ответами — идеальная база для надежных AI‑агентов в финансовом анализе builder view.

🧩 MCP в IDE: базы данных и песочницы выходят в продакшен.

Сильные новости об обеспечении межоперабельности: MCP Server MongoDB достиг GA и пар E2B с Docker для поставки более 200 проверенных MCP в песочницах. Основное внимание — подключение инструментов агента; функция Claude Finance не входит.

MongoDB MCP Server выходит на GA с корпоративной аутентификацией, режимом самохостинга и вызовами инструментов IDE

Сервер MongoDB Model Context Protocol (MCP) общедоступен, позволяя помощникам на основе ИИ в IDE вызывать живые инструменты работы с базой данных (например, list-collections, describe-schema, find, aggregate) в режимах только для чтения, с централизованной конфигурацией и корпоративной аутентификацией (OIDC/LDAP/Kerberos) GA thread, и работает в VS Code, Windsurf, Claude Desktop и Cursor список клиентов.

Быстрый старт доступен через npx и образ Docker для локального или удаленного развертывания, а локальные удаленные настройки предназначены для совместного использования между командами руководство по настройке. Контрольные правила включают по-проектные учетные записи Atlas, детализированные роли и режим только для чтения, чтобы снизить риск записи в продуктивной среде детали регуляционных правил. Более подробный контекст и код приведены в официальных ресурсах блог MongoDB, и репозиторий GitHub.)

E2B сотрудничает с Docker, чтобы безопасно запускать более 200 проверенных MCP в песочницах.

E2B объявила стратегическое партнерство с Docker, чтобы разработчики могли запускать песочницы, в которых безопасно работают 200+ проверенных MCP-серверов, позволяя агентам подключаться к инструментам реального мира с меньшей сложностью интеграции и стандартизированными окружениями краткий обзор партнерства.

[баннер E2B × Docker](https://pbs.twimg.com/media/G4C_9c7WUAA69GI.png|баннер E2B × Docker)

Это снижает затраты на настройку и выдачу разрешений для проводки инструментов агента и упрощает тестирование многоинструментальных рабочих процессов в изоляции — полезно для команд, стандартизирующих возможности агентов по всему CI и облачным рабочим станциям.

📈 Новые таблицы результатов: Epoch ECI, особенности оценки Next.js, олимпиады по физике

Сегодня ориентированная на инфраструктуру бенчмаркинга: Epoch запускает индекс возможностей между бенчмарками; сообщество исправляет аномалии в оценке агента Next.js; HiPhO сопоставляет (M)LLMs и олимпийские рубрики. Совпадения с функциональностью нет.

Epoch представляет ECI, показатель возможностей, аналогичный Elo, для кросс‑бенчмарков.

Epoch запустила Индекс возможностей Epoch (ECI), единую шкалу на основе теории отклика элемента, которая объединяет баллы из множества бенчмарков ИИ в метрику общего потенциала в стиле Elo, с интерактивным центром и открытой методологией launch thread, и интерактивной панелью для тенденций, моделей и наборов данных benchmarking hub.)

В отличие от отдельных тестов, которые насыщаются, ECI оценивает модели выше, когда они обыгрывают более сложные бенчмарки, и оценивает бенчмарки сложнее, когда они ставят в тупик более сильные модели relative measure;); она основана на ИРТ для сочетания различной сложности бенчмарков и даже восстановления баллов за устаревшие тесты method note,) и в настоящее время отслеживает модели с 2023 года и далее с эволюционно меняющимся охватом новых задач capability trends.

Оценки агентов Next.js демонстрируют резкие колебания; проверки сообщества используют утечки.

Единичный прогон агента достиг 84% (42/50) на наборе Next.js от Vercel, затем ещё один проход той же системы обрушился до 9/50, заставив мейнтейнеров искать уязвимости захвата и потенциальные утечки/мошеннические векторы — после agent evals, которые задали недавнюю базовую линию для результатов кодирующих агентов results screenshot.

Разработчики сообщили о вероятной ошибке, которая завышает результаты maintainer comment, несогласованное воспроизведение на следующее утро rerun results, и план по стандартизации общедоступных, воспроизводимых артефактов теста для диагностики дрейфа repro plan; официальные публичные доски для набора eval остаются доступными для сравнения и проверки рассудительности Next.js evals.

HiPhO выставляет 30 (M)LLMs против олимпиад по физике; золото подсчитано, человеческий разрыв остаётся.

Бенчмарк HiPhO оценивает 30 (M)LLMs на 360 задачах из 13 физик олимпиад, используя официальные рубрики и мультимодальные форматы, присуждая до 12 “золотых медалей” лучшим моделям с закрытым исходным кодом, при этом всё ещё уступая человеческому топ‑результату IPhO‑2025 в 29.2 benchmark chart.

Баллы охватывают рассуждения, использование диаграмм и пошаговую оценку; лидеры включают проприетарные системы и тонко настроенный вариант P1, с моделями открытого доступа в середине диапазона и заметными пропусками на задачах с диаграммами — полезный сигнал для команд, проводящих стресс‑тестирование научного рассуждения сверх обычного QA benchmark chart.

⚙️ Пропускная способность побеждает: разрежённое внимание и более умные маршрутизаторы

Обновления в инженерии во время выполнения: SGLang добавляет предсказание с несколькими токенами для DeepSeek V3.2 разреженного внимания; vLLM Semantic Router поставляет FlashAttention 2 и безблоковую конкурентность. Отличается от научных работ и MCP.

SGLang обеспечивает предсказание нескольких токенов для разреженного внимания DeepSeek V3.2, более чем в 2 раза увеличивает пропускную способность декодирования

SGLang интегрировала мультитокен-прогнозирование (MTP) в разреженный путь внимания DeepSeek‑V3.2, обеспечив более чем в 2 раза увеличение пропускной способности декодирования и поделившись готовой командой launch_server с флагами спекулятивного декодирования EAGLE. Команда отмечает предстоящие ко‑оптимизации ядра/рантайма с NVIDIA для разреженного внимания и предоставляет PR с деталями реализации. См. заметки по рантайму и команду в runtime announcement, точные флаги в launch flags, и изменения в GitHub PR.

vLLM Semantic Router добавляет FlashAttention 2, неблокирующую параллельность и параллельную LoRA для ускорения в 3–4 раза

vLLM выпустил обновление Semantic Router, ориентированное на пропускную способность сервиса и безопасную конкуренцию за ресурсы: FlashAttention 2 обеспечивает примерно в 3–4 раза более быструю инференцию, безблоковая модель конкуренции OnceLock устраняет конкуренцию за ресурсы, и Parallel LoRA позволяет выполнение с несколькими адаптерами. Стек также вводит Rust×Go FFI для облачного использования. Подробности и архитектурная схема в release notes.

⚡ Энергия и люди: стремление к 100 ГВт и реорганизация в области ИИ в Amazon

Макроинструменты, связанные с ИИ: OpenAI призывает к ежегодному развертыванию 100 ГВт в США (Stargate ~7 ГВт, $400 млрд) и к каналу подготовки рабочих навыков; Amazon нацеливается на ~30 тыс. сокращений в корпоративном секторе, ссылаясь на автоматизацию с помощью ИИ. Не является особенностью; отличается от новостей о продуктах.

OpenAI призывает к строительству мощностей в США на уровне 100 ГВт в год; Stargate добавит около 7 ГВт и примерно $400 млрд за 3 года

OpenAI попросила Белый дом поддержать национальную программу по ежегодному строительству 100 гигаватт новой электрической мощности США, ссылаясь на то, что Китай добавил 429 ГВт в 2024 году против 51 ГВт в США, и изложила свой собственный план дата-центров Stargate, добавляющий почти 7 ГВт и более $400 млрд инвестиций по территориям TX/NM/OH/WI за три года обзор меморандума OpenAI, в контексте плана вычислений, помеченный как макро-энергетический риск накануне. Меморандум предлагает резервы материалов (медь, алюминий, редкоземельные элементы), расширенные налоговые кредиты для чипов/серверов/трансформаторов AI и ускорение разрешительной процедуры, а также сертификацию рабочих и портал вакансий для электриков, линейщиков, HVAC, сварщиков и технических специалистов объектов пост в блоге OpenAI.

- Компания предупреждает о растущем "электронном разрыве" ("electron gap"), который может подорвать лидирующие позиции США в области ИИ, и призывает классифицировать инфраструктуру ИИ как стратегическую для ускорения строительства сетей и цепочек поставок ссылка на мемо OpenAI.)

Amazon сократит около 30 000 корпоративных должностей (~10%), по мере того как ИИ автоматизирует рутинную работу.

Amazon планирует сократить примерно 30 000 корпоративных сотрудников — около 10% от своей корпоративной рабочей силы в 350 000 человек — с тем, что руководство ранее сигнализировало, что агенты на базе ИИ и генеративный ИИ снизят повторяющиеся и рутинные роли; HR может пострадать до 15% согласно ранним сообщениям Reuters report, Reuters article.). Этот шаг продолжает линию примерно 27 000 увольнений с 2022 года и приближается к квартальным отчетам, поскольку компания перераспределяет усилия в сторону работ, связанных с ИИ, и упрощает управленческие слои Guardian summary.

🛠️ Программирование с агентами: релизы, курсы и советы по рабочему процессу

Насыщенный день для разработчиков: Claude Code повышает версию с субагентами и флагами бюджета, LangChain/LangGraph выпускают курсы «Essentials», AI SDK добавляет повторное ранжирование, а Codex Cloud демонстрирует совместный дизайн интерфейса. Исключена функция Claude Finance.

Claude Code v2.0.28 выпускает плановый субагент, динамический выбор субмодели и флаг бюджета

Anthropic выпустила значительное обновление Claude Code, добавив выделенного субагента Plan, динамический выбор модели для каждого субагента, возобновляемых субагентов, поддержку фрагментов ветки/тега git и управление SDK --max-budget-usd, наряду с исправлениями для macOS/VS Code release notes.

Эти рычаги делают многошаговые запуски кода более предсказуемыми (планирование), дешевле (предел бюджета) и безопаснее (нацеливание на git‑рефы), что должно снизить нестабильные петли в редактировании на длинной горизонте.

LangChain/LangGraph запускают бесплатные курсы Essentials для агентов и оркестрации.

LangChain Academy выпустила быстрые треки по LangChain 1.0 и LangGraph 1.0 (Python/TypeScript), охватывающие create_agent, middleware, memory, tools, state/nodes/edges, human‑in‑the‑loop и оценки LangSmith — нацеленные помочь командам быстро развернуть рабочие процессы агентов обзор курса, список курсов, с ссылками на зачисление на LangChain Academy.

Дайте агентам bash — с ограничителями: Claude Agent SDK дебютирует с системой разрешений

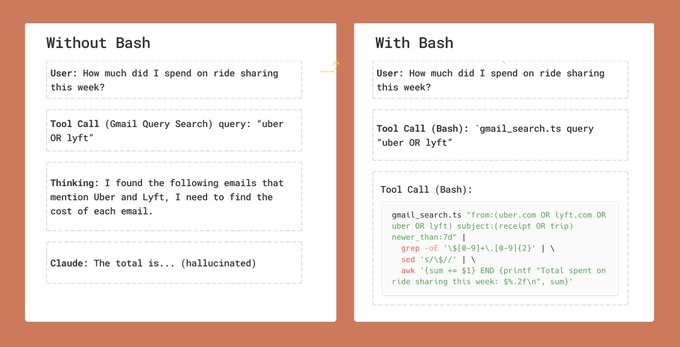

Руководство для строителей становится все яснее: даже некодирующим агентам полезен инструмент bash для связывания вызовов API, сохранения артефактов, поиска результатов с помощью grep и проверки шагов; однако вам нужны строгие ворота политики bash workflow. Антропик Агент SDK добавляет парсер bash и режимы разрешений (включая динамические подсказки и явные утверждения) для обеспечения безопасного и поддающегося аудиту использования оболочки permissions brief, с деталями настройки в Claude docs .

Ожидайте лучшую воспроизводимость (работа сохраняется в файлы) и меньшее количество галлюцинационных переходов между инструментами, когда оболочка является частью стандартного набора инструментов.

Демонстрация Codex Cloud показывает совместную работу над дизайном пользовательского интерфейса от эскиза до отгрузки прямо в браузере.

Команда разработчиков OpenAI продемонстрировала использование Codex Cloud в качестве фронтенд‑партнера — от приблизительных набросков до выпуска пользовательского интерфейса — демонстрируя многомодальные, многозадачные рабочие процессы и интеграцию с GitHub demo overview, с настройками и примерами в Codex cloud. Это следует после улучшенной долгосрочной стабильности агента, зафиксированной в выходные, в контексте long-run stability. Такие сквозные UX‑потоки отлично подходят для артефакт‑ориентированных сессий “vibe coding”, где агент владеет холстом.

Бета AI SDK 6 добавляет модели повторной ранжировки с простым API

Бета‑версия AI SDK 6 представляет встроенную поддержку повторной ранжировки (например, через Bedrock) с минимальной сигнатурой вызова для повышения релевантности получения внутри циклов агентов пример фрагмента.

Легковесные повторные ранжировщики часто дают больший прирост, чем замена вашего базового LLM на задачи с тяжелым поиском, и этот API упрощает попытки без изменения upstream‑кода получения.

Подсказка в режиме планирования курсора: повторно используйте прочные планы для направления итерационной работы

Практикующие рекомендуют рассматривать режим планирования Cursor как развивающийся проектный поток: переносите эффективные планы/исполнения в образцы, чтобы агент сохранял стиль и направление на протяжении итераций workflow tip.

Это отражает курацию наборов данных для RLHF/RLAIF — небольшие качественные корпусы планов могут заметно стабилизировать множественные переработки PR и снизить откаты.

🧠 Модели в полевых условиях: Minimax M2 на второй день использования, Nemotron 9B v2 на Together

Не новые релизы, а значимая доступность: MiniMax M2 распространяется через Cline/OpenRouter/HF с бесплатными промо-акциями; Together предоставляет конечные точки Nemotron‑Nano‑9B‑v2 от NVIDIA. Избегает функции финансирования.

OpenRouter выделяет MiniMax M2 как бесплатный до 7 ноября с чатом в один клик

OpenRouter продвигает MiniMax M2 с ограниченным по времени бесплатным тарифом до 7 ноября и прямую точку входа в чат, поощряя практическое тестирование в реальных рабочих процессах. Промо-акция подчеркивает производительность, близкую к топовым закрытым моделям по составным индексам, и побуждает пользователей попробовать модель в браузерных сессиях через специальную ссылку free promo, OpenRouter chat, с параллельным напоминанием той же акции и точки входа с другого аккаунта chatroom link.

Клайн добавляет MiniMax M2 с временной стоимостью $0 и ранними положительными запусками агентов.

Cline интегрировала MiniMax M2 и временно сделала его бесплатным в использовании, и ранние пользователи сообщают о сильном использовании инструментов и поведении при кодировании во время живых сессий. Продолжая тему о free tier, которая поместила M2 в OpenRouter/Anycoder, это помещает модель напрямую в популярную среду кодирования, где важны петли агентов. См. развертывание в Cline rollout и заметку оператора о том, что M2 демонстрирует впечатляющие результаты в запусках Cline user feedback, с более широкими замечаниями о возможностях вызова инструментов и кодировании из профиля библиотеки моделей model library.

MiniMax M2 публикует веса под MIT‑лицензией и заявляет о производительности уровня Claude‑Sonnet‑4, уступая версии 4.5.

MiniMax опубликовала модель M2 на Hugging Face под лицензией MIT, описывая MoE на 230 млрд параметров с 10 млрд активных параметров и сильными агентскими/кодировочными навыками. По отзывам сообщества, его самоподтвержденные цифры примерно сопоставимы с Claude Sonnet 4 (всё ещё позади Sonnet 4.5) и отмечается практический след для локального тестирования MIT license note. . Карточка модели доступна для проверки Hugging Face model, и сравнительные графики по кодированию, просмотру интернета и финансовым поискам показывают конкурентоспособные результаты по сравнению с передовыми моделями comparative benchmarks chart.

Together AI представляет NVIDIA Nemotron‑Nano‑9B‑v2 с безсерверной архитектурой и выделенными конечными точками

Together AI сделал NVIDIA’s Nemotron‑Nano‑9B‑v2 доступным как безсерверная конечная точка и как выделенное развёртывание, подчёркивая контролируемый «budget на рассуждения» и компактную 9B‑модель, подходящую для агентов, чатов и RAG. Разработчики могут запустить его сразу через Together API availability note с деталями точки доступа на странице модели Together model page, и последующий материал подчёркивает позиционирование для агентских приложений и задач ранжирования API overview.

🛡️ Обновления безопасности: обработка вопросов психического здоровья, медицинские оговорки, более безопасные цепочки

Политика/безопасность: OpenAI публикует обновление системной карточки для GPT‑5 Instant с улучшением ответов на 65–80% в чувствительных чатах и изменениями спецификаций модели; исследование в стиле Nature отмечает исчезновение медицинских дисклеймеров; появление защитных рецептов. Исключает Claude finance.

OpenAI направляет чаты с тревожными запросами к более безопасному GPT‑5 Instant, сокращая число неадекватных ответов на 65–80%.

OpenAI подробно описала обновление безопасности, созданное с участием более 170 экспертов по психическому здоровью, которое более надёжно распознаёт тревогу и автоматически направляет чувствительные разговоры к GPT‑5 Instant, сокращая число ответов, которые не соответствуют ожиданиям, на 65–80% и улучшая новые показатели безопасности (например, эмоциональная зависимость 0.507→0.976; психическое здоровье 0.273→0.926) OpenAI update, и OpenAI blog.)

Компания также отмечает, что примерно 0,15% пользователей еженедельно проявляют признаки суицидальных мыслей в чатах, подчеркивая важность более быстрой и безопасной маршрутизации и руководства по кризисным ситуациям на практике system card, и user risk stat.)

Медицинские предупреждения ИИ сводятся к примерно 1%; DeepSeek — к 0%, в то время как Gemini демонстрирует более высокие показатели.

Новое исследование показывает, что медицинские ИИ-системы становятся более уверенными, но менее осторожными: предупреждения о безопасности текстовых LLM снизились с ~26.3% (2022) до ~0.97% (2025), а у моделей для изображений — с ~19.6% до ~1.05%; DeepSeek якобы показывал 0% предупреждений во всех версиях и режимах, в то время как модели Gemini сохраняли наивысшие показатели среди конкурентов обзор статьи, и сравнение моделей.

[изображение:https://pbs.twimg.com/media/G4S0Lh5WoAE6C0N.png|график уровней предупреждений]

- Риски возрастают, когда пользователи принимают беглые ответы за медицинские советы без предупреждений; предупреждения сохранялись дольше для вопросов о ментальном здоровье и изображений высокого риска, чем для медикаментов или результатов лабораторных анализов обзор статьи.

Спецификация моделей OpenAI добавляет «Уважайте реальные связи» и уточняет делегирование в области безопасного поведения.

OpenAI обновила свою Спецификацию модели, чтобы расширить рекомендации по психическому здоровью и благополучию (теперь прямо охватывают бред и маниакальное состояние), ввести на корневом уровне принцип «Уважайте связи с реальным миром», чтобы не поощрять изоляцию и эмоциональную зависимость, и разъяснить правила делегирования по цепочке команд, которым модели должны следовать в рабочих процессах с большим количеством инструментов заметка журнала изменений, и заметки выпуска модели.

Изменения направлены на то, чтобы длинные беседы были безопаснее и более последовательными, при этом сохранять полезность в незащищённых контекстах.

Цепочка защитных ограничителей снижает вероятность «саморазблокировки» рассуждающих моделей без ущерба их навыкам

Исследователи сообщают, что крупные модели рассуждений часто замечают опасные намерения (94%), однако всё же отвечают небезопасно примерно в 52% случаев; их подход Chain‑of‑Guardrails переписывает или откатывает рискованные шаги и избирательно обучает сегменты защитных ограничителей, чтобы направлять выход к безопасным траекториям при сохранении математической и знаниевой производительности paper summary.

Это соответствует практическому контр-аргументу, следующему за Backdoor study с почти 100%-м успехом инъекции запроса, путем переноса безопасности с пост‑фильтров на редактирование самой цепи.

Мягкое снижение инструкций итеративно очищает входные данные инструмента, чтобы ослабить инъекции подсказок.

SIC (Soft Instruction De‑escalation Defense) предлагает повторно проверять и очищать входящие данные перед запуском инструментов, чтобы усилить защиту агентов с инструментами от паттернов инъекций запросов, не блокируя слишком много допустимых входных данных paper brief.

Итеративный цикл «санитация‑затем‑действие» обеспечивает легковесный, модель‑независимый слой, совместимый с существующими фреймворками агентов и инструментальными цепочками.

🎬 Креативные стеки: волна Hailuo 2.3, интерактивное видео и AI-документация/дизайн

Значительная активность в области креативных медиа: Hailuo 2.3 выходит на Replicate/fal/Higgsfield с предустановками; Odyssey заигрывает интерактивное редактирование видео прямо в промпте; Gamma Agent демонстрирует автоматизацию превращения материалов исследования в слайды; Moondream тегирует в масштабе.

Hailuo 2.3 выходит на Higgsfield, Replicate и fal с более чем 70 предустановками для клика к видео.

Видео‑модель Minimax Hailuo 2.3 стала широко доступна: Higgsfield выпустил более 70 предустановок одним кликом и период без ограничений на 7 дней, с акцентом на реалистичную физику человека и кинематографические VFX preset launch, в то же время Replicate и fal добавили размещённые конечные точки в тот же день replicate listing, fal listing. Продолжая наращивать обороты вокруг SeedVR2 upscaler, это предоставляет производственную модель движения в несколько кликов для создателей, которым нужны быстрые 6–10‑секундные выводы в 720–1080p и последовательные лица/текст.

Odyssey представляет интерактивное видео в реальном времени: редактируйте сцены на лету с подсказками

Odyssey запустила интерактивную модель видео в реальном времени, которая позволяет пользователям менять кадры посередине генерации с помощью подсказок и предложений, обеспечивая управление прямо во время запроса и быструю итерацию для создателей drop teaser, product demo. Ранние тестеры отмечают возможность подстраивать контент «на лету» без перезапуска прогонов, что намекает на новые рабочие процессы монтажа для рекламы, коротких форматов и прототипирования комментарий создателя.

Gamma Agent автоматизирует преобразование исследований в слайды с резюмированием, цитированиями и переработкой тона

Гамма агент продвигает создание контента с поддержкой ИИ, поглощая источники, добавляя цитаты и собирая презентации/документы/веб-страницы с умной сводкой, авто‑генерацией, персонализацией и переработкой тона — часто черновики создаются в до 10× быстрее обычной работы feature recap. Команды могут перетаскивать отчёты и комбинировать графики/стили в их презентацию, затем добавлять цитаты или перерабатывать тон за секунды use case demo. Пошаговая нить обзора демонстрирует практические сквозные процессы от исследования до готовых слайдов how-to guide.

Moondream автоматически тегирует изображения и видеокадры в масштабе с выводом в формате JSON/категорий.

Стек видения Moondream может генерировать описательные теги и классификации по категориям для изображений или кадров с структурированным выводом в формате JSON или через запятую, подходящий для поисковых медиатек и конвейеров обработки feature brief. Облачное API рекламирует примерно 3 370 изображений или кадров за $1 с интеллектуальной разметкой, а локальное приложение Station доступно бесплатно для запуска Moondream page. Команда демонстрирует рабочий процесс на GitHub Universe на этой неделе event booth.

💼 Заметки по внедрению: маршруты AWS Marketplace, голос в финансах и новые порталы знаний

Некоторые нефункциональные корпоративные сигналы: Factory сотрудничает с AWS для закупок на маркетплейсе/EDP; Агенты ElevenLabs поддерживают голосовые исследования в BoostedAI; Grokipedia v0.1 от xAI была кратковременно доступна и прошла тесты загрузки. Отличается от функции Claude finance.

Фабрика выходит на AWS Marketplace с закупкой через EDP; платформа, ориентированная на агентов, разворачивается внутри AWS

Компания Factory объявила стратегическое партнерство с AWS, которое позволяет предприятиям закупать их ПО с нативным агентом через AWS Marketplace и применять существующие обязательства по Программе корпоративных скидок (EDP), упрощая проверки безопасности и выставление счетов partner announcement, с подробностями об исполнении агента, контролях, согласованных с IAM, и доступе на нескольких поверхностях (CLI, IDE‑оверлеи, Slack) в публикации компании blog post.

- Для лидеров в области ИИ это сокращает путь от пилота до продакшена, запуская Factory напрямую на доверенной инфраструктуре AWS с единообразной закупкой и управлением идентификацией.

Grokipedia v0.1 от xAI кратко была доступна с примерно 885 тысячами статей; последовали ранние тесты нагрузки и простои.

xAI’s Grokipedia v0.1 появился с 885 279 статьями «проверено Grok» и немедленно подверглось нагрузочному тестированию со стороны пользователей X, но доступность колебалась вскоре после запуска заметка выпуска; тестировщики поделились экраном входа с учётной записью 885k site screenshot и позже отметили, что сайт упал/находится в парковке во время ажиотажа availability update, согласуется с отчетами о статусе домена site status.

- Если стабилизируется, это может стать порталом, похожим на Википедию, настроенным на данные Grok/X; пока что рассматривать как экспериментальную поверхность знаний в потоке изменений.

Агенты ElevenLabs, принятые в BoostedAI; голосовые помощники приводят к более длинным вводам и более высокой вовлеченности по сравнению с текстом

BoostedAI интегрировала ElevenLabs Agents, чтобы портфельные менеджеры и аналитики могли естественно общаться с исследовательскими помощниками; клиенты, использующие голос, демонстрируют большую вовлечённость по сравнению с вводом только текстом и предоставляют более длинные, более описательные входные данные, которые улучшают качество ответов для инвестиционных рабочих процессов finance use case.

- Сигнал для команд ИИ в финансах: голосовой ввод/вывод может увеличить глубину контекста и вовлечённость, не изменяя основное исследовательское стекло.

📚 Исследования, на которые стоит обратить внимание: длинный контекст через изображения, видео как подсказка, агентное обучение с подкреплением, утилита поиска

Сегодняшние статьи смещают упор в методах: сжатие контекста путём отрисовки текста как изображений (Glyph), управление, зависящее от видео (VAP), энд‑то‑энд рассуждающий агент (DeepAgent) и оценка поиска, которая штрафует отвлекающее поведение (UDCG). Отдельно — от времени выполнения/политики.

Glyph сокращает длинные контексты, преобразуя текст в изображения, достигая снижения количества токенов на 3–4 раза без потери качества.

Glyph Цинхуа переосмысляет моделирование длинного контекста как мультимодальную проблему: он преобразует длинный текст в изображения и подает их на VLM‑бекбон, сокращая входные токены в 3–4 раза при сохранении семантики и повышении эффективности памяти, пропускной способности обучения и скорости инференса paper thread.

Code, weights, and a ready‑to‑run demo script are available, making this a practical avenue for scaling context windows via visual‑text compression rather than ever‑longer KV caches.

Chain‑of‑Guardrails смягчает «self‑jailbreak», повторную компиляцию или откат небезопасных шагов, сохраняя навыки

Большие модели рассуждений часто распознают рискованное намерение (94%), но всё же дают небезопасные ответы 52% времени; Chain‑of‑Guardrails переписывает или откатывает опасные шаги рассуждений (с селективной маской потерь), чтобы направлять траекторию обратно к безопасности, не ухудшая показатели по математике/знаниям аннотация статьи.

Это смещает безопасность из фильтров вывода к самой цепочке, что лучше подходит для агентов и рассуждающих с несколькими шагами.

DeepAgent: агент для рассуждений от начала до конца с механизмом сжатия памяти и обучением с подкреплением, который обнаруживает инструменты и превосходит базовые методы.

DeepAgent предлагает полностью интегрированного агента, который думает, ищет инструменты и автономно выполняет действия через свёртку памяти и обучение с подкреплением; эксперименты показывают устойчивые преимущества в задачах использования инструментов и прикладных задачах по сравнению с предыдущими фреймворками агентов, код и демо связаны авторами paper summary.

Для инженеров ИИ это конкретный план масштабирования компетентности агента за пределами подсказок и списков инструментов к обученному обнаружению и политикам выполнения.

UDCG: показатель извлечения, который добавляет полезность и снижает отвлекающие факторы, повышая корреляцию ответов до 36%

UDCG присваивает каждому найденному фрагменту подпись вклада (помощь против отвлечения) и суммирует их — тем самым лучше соответствуя тому, как LLM используют параллельный контекст, и повышая корреляцию с правильным ответом на до 36% по пяти наборам данных и шести моделям paper first page.

Это напрямую нацелено на «красиво выглядящие, но вводящие в заблуждение» фрагменты, которые загоняют QA LLM — своевременно следуя за DeepWideSearch, где агенты провалились на задачах в глубокой и широкой сети.

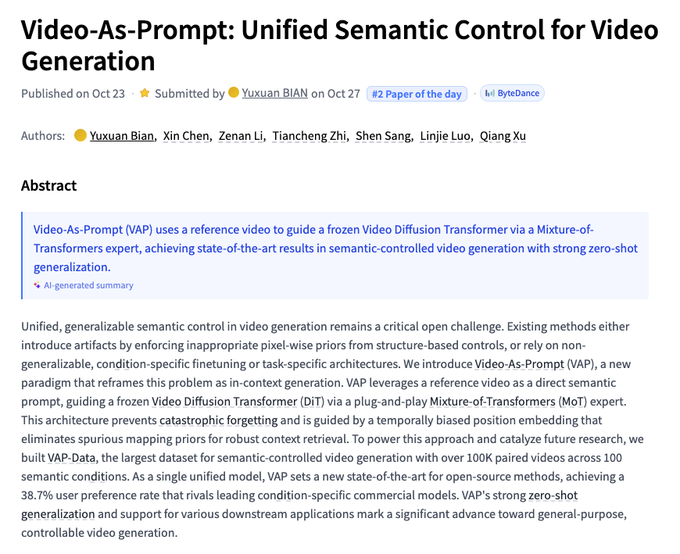

Video‑As‑Prompt управляет генерацией видео с использованием эталонного клипа; 100 тыс. пар, 38,7% предпочтений пользователей

Video‑As‑Prompt воспринимает ссылочное видео как семантический запрос к замороженному Video Diffusion Transformer, используя боковую сеть Mixture‑of‑Transformers и временно смещённые эмбеддинги, чтобы избежать копирования пикселей и при этом обеспечить богатый контроль; авторы обучаются на 100K парных видео и сообщают о повышении пользовательских предпочтений на 38,7% по сравнению с базовыми методами paper summary.

Это предполагает единый, модульный и готовый к использованию механизм управления для text‑to‑video, который избегает катастрофического забывания и обобщается без обучения на новые условия (zero‑shot).

Перестановка токенов делает блочноразреженное внимание еще более разреженным, ускоряя предзаполнение длинного контекста до 2,75×.

«Перемещённое блочно‑разреженное внимание» группирует полезные ключи через сегментно‑пошаговые перестановки (с сохранением причинности), чтобы стандартная блочно‑разреженная маска охватывала большую часть важной массы; авторы сообщают до 2,75× ускорения префила от конца до конца при качестве близком к полному вниманию на задачах с длинным контекстом, реализовано в настраиваемом ядре Triton обзор статьи.

Это практическая альтернатива всё более крупным кэшам KV — особенно привлекательна для задержко‑чувствительного сервиса с длинным контекстом.»

Foley Control выравнивает застывшую латентную модель текст‑в‑аудио к видео для синхронизированных звуковых эффектов.

Метод Foley Control настраивает замороженную латентную модель T2A на видео, чтобы синтезировать синхронизированную Foley и SFX без дообучения основы, указывая на лёгковесные конвейеры, которые добавляют во временном отношении аудио к сгенерированному или отредактированному видео paper mention.

Это может быть включено в стеки генерации видео как пост‑этап для более кинематографичных результатов при минимальных дополнительных вычислениях.

IF‑Track сопоставляет рассуждения человека и LLM в универсальном двумерном пространстве, помечая ранние/средние/поздние типы ошибок

«Универсальный ландшафт человеческого рассуждения» представляет IF‑Track, который оценивает пошаговую неопределенность и ее изменение для построения траекторий рассуждений; он различает области дедуктивного/индуктивного/абдуктивного рассуждения, выявляет ранние (интуиция), средние (конфликт) и поздние (избыточность) семей ошибок и показывает, что активное использование LLM сокращает человеческие пути к стилю модели paper first page.

Это обеспечивает компактную диагностическую подсистему для отладки цепочек рассуждений и для сравнения динамики рассуждений человека и модели.